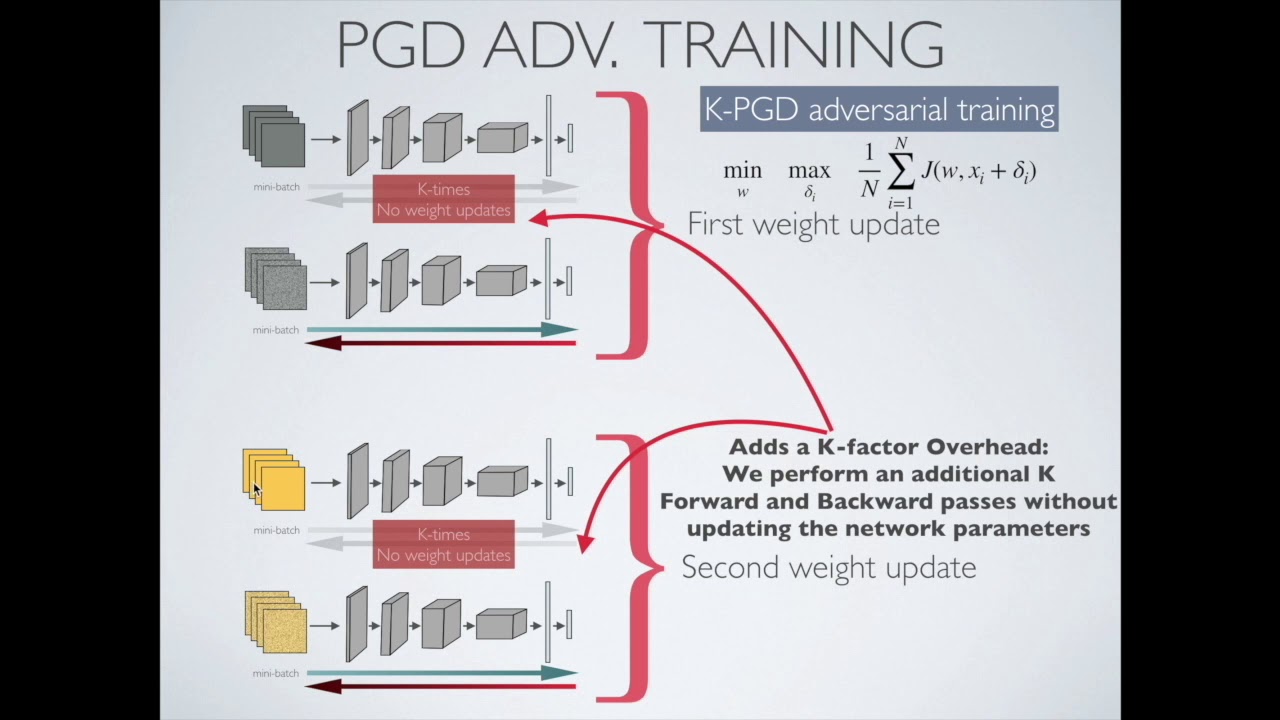

적대적 훈련은 딥러닝에 사용되는 머신러닝 기술의 한 유형입니다. 이는 모델이 레이블이 지정된 데이터에 대해 훈련되고 주어진 입력의 출력을 예측하는 데 사용되는 지도 학습의 한 형태입니다. 다른 형태의 지도 학습과 달리, 적대적 훈련에는 훈련된 모델의 정확성과 견고성을 향상시키는 적대적 요소가 포함되어 있습니다.

적대적 훈련은 훈련 데이터 세트에 소수의 잘못된 예를 도입함으로써 작동합니다. 이러한 잘못된 예는 실제 예를 잘못 분류되도록 수정하는 "적대적" 방법에 의해 생성됩니다. 적대적 훈련의 목표는 참과 거짓 사례를 모두 정확하게 분류할 수 있는 모델을 만드는 것입니다.

적대적 훈련은 정확도를 최대 15%까지 높일 수 있는 이미지 분류 작업에 특히 유용합니다. 이미지 분류 외에도 음성인식, 자연어 처리 등 다양한 분야에서 활용됩니다.

적대적 훈련은 더 나은 일반화, 견고성 및 정확성 가능성으로 인해 점점 인기를 얻고 있습니다. 모델을 훈련하려면 수많은 거짓 예제를 생성해야 하기 때문에 적대적 훈련에는 엄청난 양의 컴퓨팅 성능과 데이터가 필요하다는 점을 기억하는 것도 중요합니다.