Pelatihan permusuhan adalah jenis teknik pembelajaran mesin yang digunakan dalam pembelajaran mendalam. Ini adalah bentuk pembelajaran terawasi di mana model dilatih pada data berlabel dan digunakan untuk memprediksi keluaran dari masukan tertentu. Tidak seperti bentuk pembelajaran terawasi lainnya, pelatihan adversarial menggabungkan elemen adversarial yang mendorong peningkatan akurasi dan ketahanan model yang dilatih.

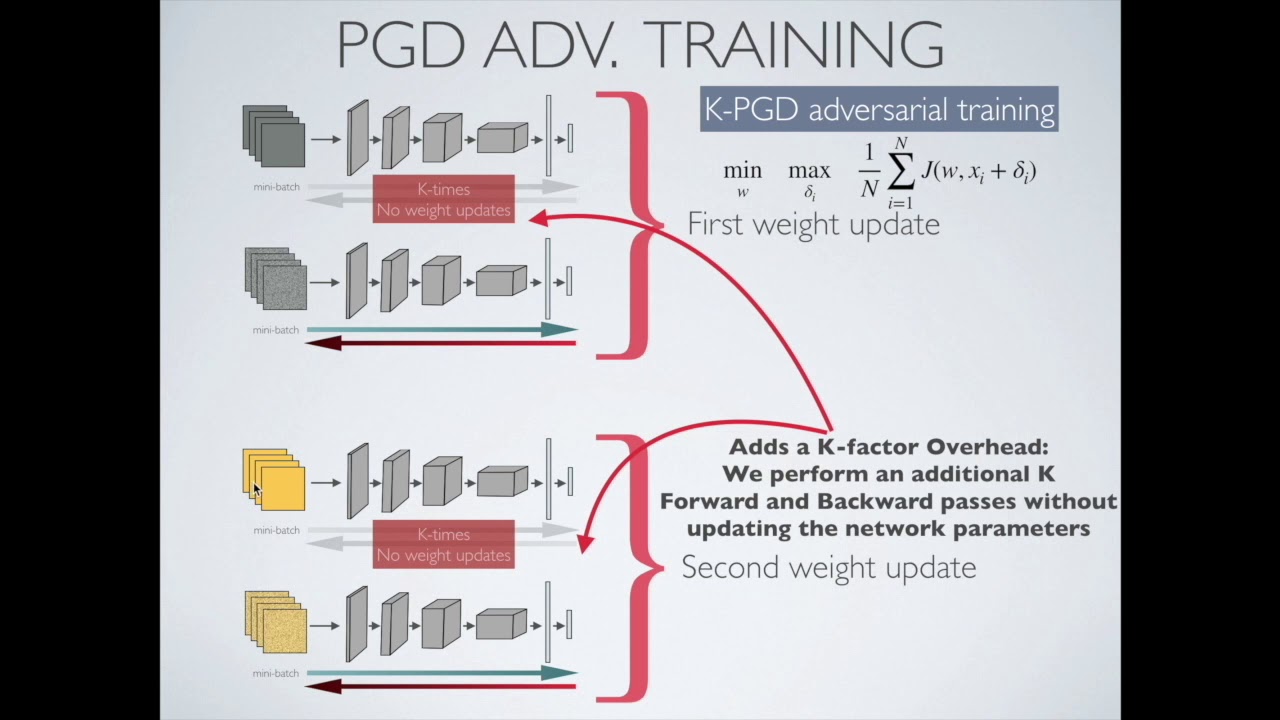

Pelatihan permusuhan bekerja dengan memasukkan sejumlah kecil contoh palsu ke kumpulan data pelatihan. Contoh-contoh palsu ini diciptakan oleh metode “adversarial” yang memodifikasi contoh sebenarnya sedemikian rupa sehingga menyebabkan kesalahan klasifikasi. Tujuan dari pelatihan permusuhan adalah untuk menciptakan model yang dapat mengklasifikasikan contoh yang benar dan yang salah secara akurat.

Pelatihan permusuhan sangat berguna dalam tugas klasifikasi gambar, yang dapat meningkatkan akurasi hingga 15%. Selain klasifikasi gambar, ini juga digunakan dalam pengenalan suara, pemrosesan bahasa alami, dan banyak bidang lainnya.

Pelatihan permusuhan menjadi semakin populer karena potensi generalisasi, ketahanan, dan akurasi yang lebih baik. Penting juga untuk dicatat bahwa pelatihan adversarial memerlukan daya komputasi dan data yang sangat besar karena sejumlah besar contoh palsu harus dibuat untuk melatih model.