La memoria a breve termine (LSTM) è un tipo di rete neurale ricorrente (RNN) sviluppata dai ricercatori di Google Brain nel 1997. È un tipo di rete neurale artificiale utilizzata nell'apprendimento profondo, in particolare nell'elaborazione del linguaggio naturale (PNL) e nel tempo elaborazione in serie. È un'alternativa alle RNN tradizionali, che soffrono del problema del gradiente evanescente.

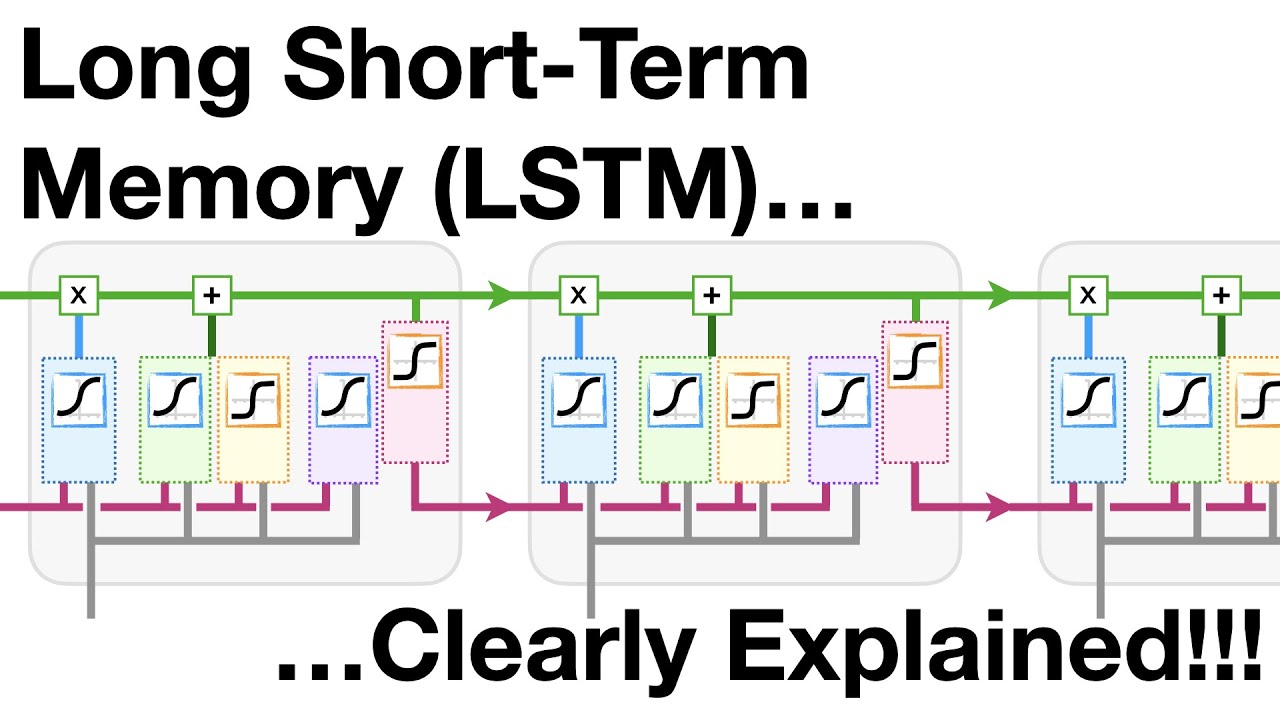

Le reti LSTM sono composte da strutture speciali chiamate blocchi, in cui ciascun blocco ha diversi strati di neuroni. Questi neuroni includono una porta di input, una porta di uscita e due porte ricorrenti che ricordano i valori per un certo periodo di tempo. Ciò consente alla rete di ricordare le informazioni per un periodo di tempo più lungo. Nello specifico, ogni neurone all'interno della rete riceve il suo input, quindi genera un output a seconda dei suoi pesi (cioè delle connessioni sinaptiche tra i neuroni).

Le reti LSTM sono state ampiamente utilizzate in applicazioni quali l'elaborazione del linguaggio, il riconoscimento vocale, la conversione da testo a voce e la comprensione del linguaggio naturale. Pertanto, gli LSTM sono più efficaci per i problemi in cui è richiesta una memoria a lungo termine.

In sintesi, la memoria a breve termine (LSTM) è un tipo di rete neurale ricorrente che utilizza porte ricorrenti per archiviare valori per un lungo periodo di tempo, consentendone l'utilizzo per attività complesse come l'elaborazione del linguaggio naturale.