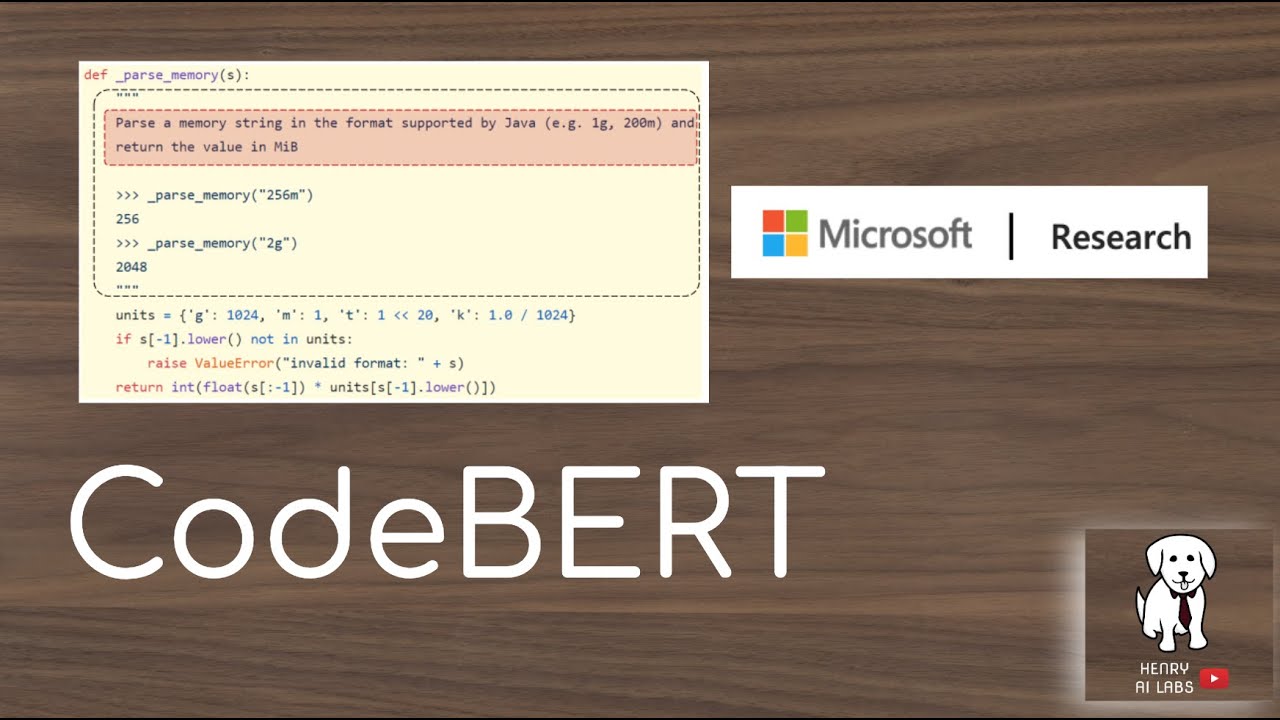

CodeBERT (Computerized Binarized Embedded Representation for Text) は、Microsoft Research によって開発されたオープンソースの自然言語処理 (NLP) モデルです。これは、感情分析、テキスト分類、文章検索、テキスト生成など、すべてテキストを入力として使用する自然言語理解 (NLU) タスク用に設計されています。 CodeBERT は、双方向アプローチを使用して言語埋め込みを生成する BERT モデルに基づいています。

CodeBERT は Transformer ベースのモデルであり、Base Google Research BERT に基づいた事前トレーニング済みの多層双方向 Transformer を使用します。 CodeBERT は、単一のネットワークを使用してさまざまなタスクを実行できる点で BERT と異なります。 CodeBERT は、文内の長距離関係と構文の両方を認識することもでき、言語の文法から学習して、文内の多くの構造を理解できるようにします。

CodeBERT は最近、感情分析、テキスト分類、パッセージ検索、テキスト生成など、さまざまな NLU タスクで優れたパフォーマンスを示しています。たとえば、CodeBERT はスタンフォード自然言語推論 (SNLI) データセットでほぼ完璧なスコアを達成しました。

CodeBERT は、質問応答や会話システムなどの他のタスクにも潜在的な利点があります。 Microsoft Research チームの一員として、CodeBERT は、カスタマー サービス ボット、質問応答システムなど、多くの実世界のタスクを使用して評価されています。

要約すると、CodeBERT は、双方向アプローチを使用して言語埋め込みを生成するオープンソースの自然言語処理 (NLP) モデルです。 CodeBERT は、さまざまな NLU タスクで優れたパフォーマンスを示しており、さまざまな種類のタスクに応用できる可能性があります。