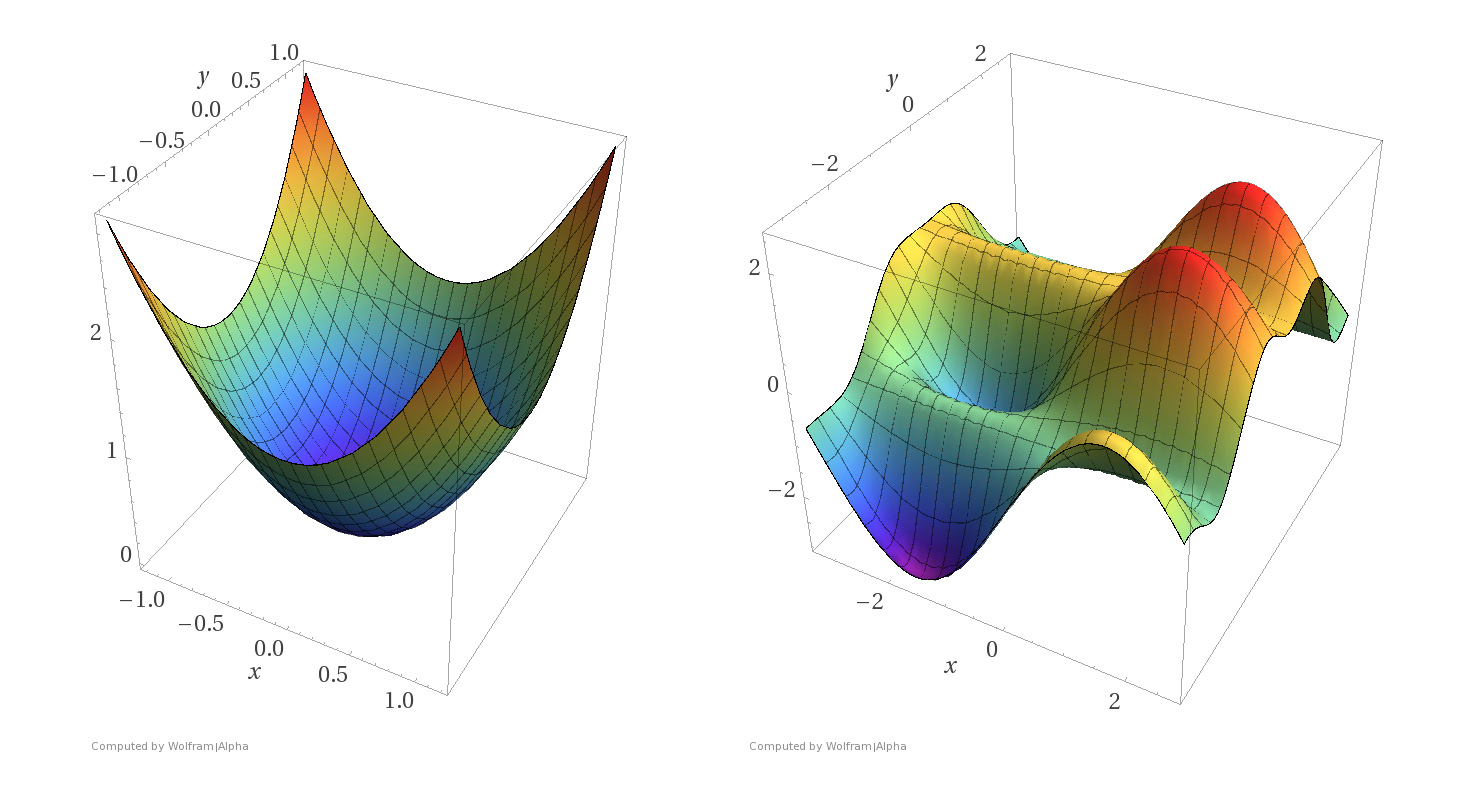

勾配降下法は、機械学習やその他の分野で目的関数を最適化するために使用されるアルゴリズムです。これは、微分可能関数の極小値を見つけるための 1 次反復最適化アルゴリズムです。勾配降下法は、データ サイエンス、統計、深層学習、その他の多くの分野におけるいくつかの最適化問題を解決するために使用されてきました。

このアルゴリズムは、特定のコスト関数を最小化する一連のパラメーター (ニューラル ネットワークの重みなど) を見つけるために使用されます。このアルゴリズムは、パラメーターの任意の初期値から始まるダウンヒル アプローチを使用してコスト関数を最小化します。

プロセスの各ステップで、アルゴリズムは最も急な降下の方向、つまりコスト関数の最も急な減少の方向にステップを踏みます。このステップのサイズは「学習率」と呼ばれるパラメータによって決まり、通常、満足のいく結果が得られるまで調整されます。

アルゴリズムは、コスト関数がそれ以上減少しなくなる点に達するまで、または早期停止パラメーターが渡された場合は反復の上限に達するまで、これらのステップを繰り返し実行します。

勾配降下法はさまざまなデータ サイエンス アルゴリズムで広く使用されており、さまざまな分野で採用されています。特に、インド工科大学は、画像処理、推定問題、時系列予測、機械翻訳などのアプリケーションを開発しました。勾配降下法は、人工ニューラル ネットワークの重みを最適化するために深層学習でも使用されます。