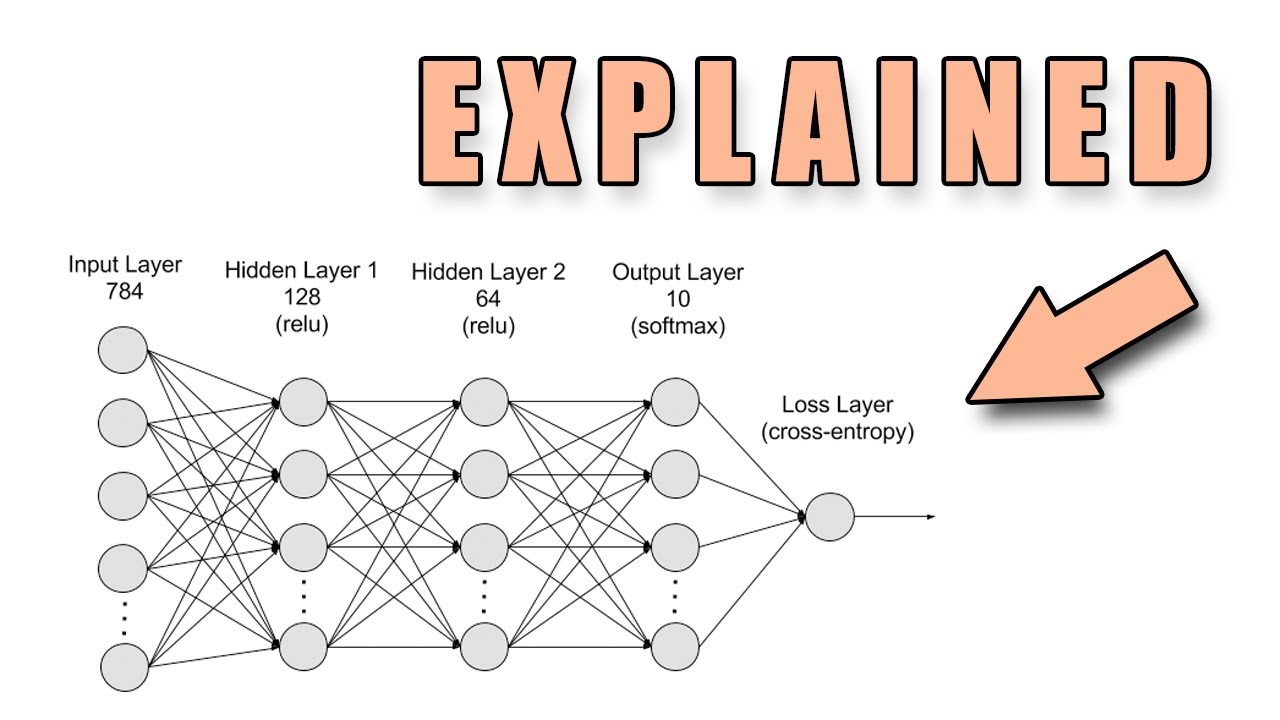

Multilayer Perceptron (MLP) là một loại mạng thần kinh nhân tạo bao gồm lớp đầu vào, lớp ẩn và lớp đầu ra. MLP phù hợp với các nhiệm vụ học có giám sát như phân loại và nhận dạng mẫu và nó thường được sử dụng trong các ứng dụng học sâu.

Lớp đầu vào của MLP bao gồm một số lượng nơ-ron nhất định hoặc một tập hợp các “nút đầu vào” được chỉ định. Mỗi nơ-ron có một trọng số nhất định tương ứng với đầu vào số và giá trị sai lệch. Một giá trị sai lệch được thêm vào tổng số đầu vào được tính toán cho mỗi nơ-ron. Lớp đầu ra của MLP là kết quả được đánh giá của lớp đầu vào bằng cách sử dụng các trọng số và giá trị sai lệch và được chuyển tiếp đến lớp ẩn.

Lớp ẩn là lớp giữa giữa lớp đầu vào và đầu ra của MLP. Lớp này chứa một số lượng nơ-ron nhất định, mỗi nơ-ron được sử dụng để xử lý thông tin đầu vào và trích xuất một mẫu nhất định. Điều này được thực hiện bằng cách áp dụng hàm kích hoạt cho đầu ra của lớp đầu vào. Hàm kích hoạt được sử dụng phổ biến nhất là Đơn vị tuyến tính chỉnh lưu (ReLU).

MLP là một trong những kiến trúc được sử dụng nhiều nhất trong lĩnh vực trí tuệ nhân tạo và học máy do tính đơn giản và linh hoạt của nó. Sau khi các tham số mô hình được huấn luyện và tối ưu hóa, nó có thể được sử dụng để đưa ra dự đoán với dữ liệu mới. MLP có thể được sử dụng cho nhiều ứng dụng khác nhau, chẳng hạn như xử lý ngôn ngữ tự nhiên, nhận dạng giọng nói, nhận dạng hình ảnh, v.v.