قابلية التفسير في التعلم الآلي هي مفهوم جعل نماذج التعلم الآلي أكثر شفافية وقابلية للفهم لجماهير متعددة، وخاصة غير الخبراء. لقد أصبحت ذات أهمية متزايدة في السنوات الأخيرة حيث أصبحت نماذج التعلم الآلي أكثر تعقيدًا.

الهدف من قابلية التفسير هو زيادة فائدة النماذج من خلال فهم سبب قيامها بتنبؤات معينة، وتقييم المخاطر المحتملة بشكل أكثر دقة لنشر النماذج غير المختبرة، والتعبير بوضوح عن سبب اتخاذ النظام للقرارات. وهو مهم أيضًا لأسباب أخلاقية، حيث يعد ضمان عدم احتواء النماذج على تحيزات تمييزية أو غير عادلة أمرًا حيويًا.

إحدى الطرق لزيادة قابلية تفسير النموذج هي من خلال التصورات. تُستخدم المرئيات مثل أشجار القرار، ومخططات أهمية الميزات، ومؤامرات الاعتماد الجزئي لإنشاء تمثيلات مرئية للنماذج التي تسهل تفسير سلوك النظام.

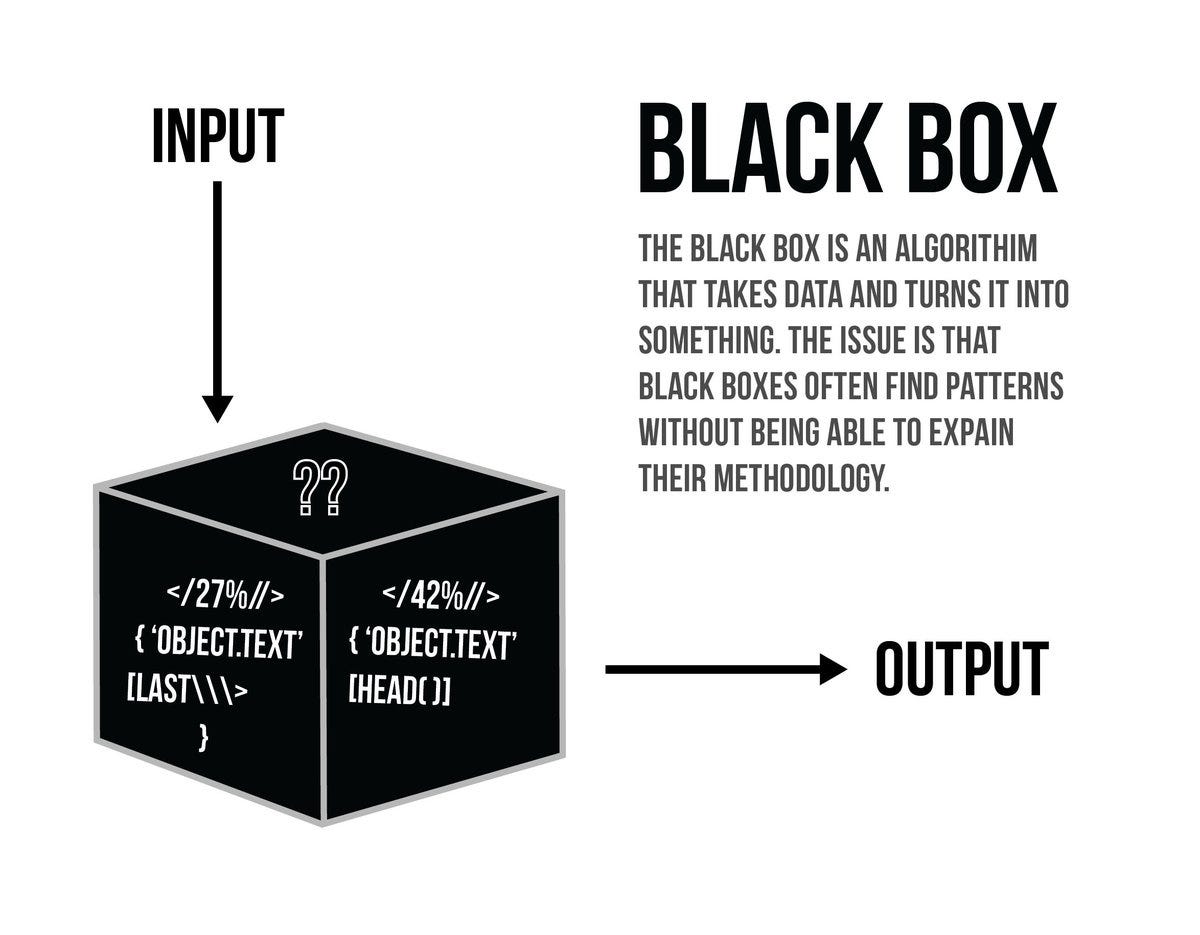

هناك طريقة أخرى لزيادة إمكانية التفسير وهي استخدام ميزات واضحة. ومن خلال استبدال الميزات الرقمية بأخرى يمكن قراءتها بواسطة الإنسان، تصبح النماذج أسهل في الفهم والثقة. ويساعد هذا أيضًا في التخفيف من الظاهرة المعروفة باسم "الصندوق الأسود"، حيث لا يكون لدى المستخدمين أي فكرة عن القرارات التي يتخذها النموذج.

بالإضافة إلى ذلك، يتم تطبيق تقنيات مثل التفسيرات على مستوى المثيل، والتي تشرح تنبؤات النموذج الفردي، بشكل متزايد في مجال التعلم الآلي لزيادة الثقة في النماذج.

وأخيرا، يمكن استخدام تقنيات مثل الأمثلة المتعارضة لقياس قوة النموذج. توفر هذه الأمثلة بعض قابلية التفسير لما يجعل النموذج عرضة للأخطاء، مثل التجهيز الزائد أو تسرب البيانات.

بشكل عام، أصبحت إمكانية التفسير جزءًا متزايد الأهمية من مشهد التعلم الآلي. ومن خلال زيادة قابلية فهم النماذج، يمكن تحديد المخاطر المحتملة قبل النشر، ويمكن تحقيق الاستخدام الفعال والإنساني للتعلم الآلي بسهولة أكبر.