Дистилляция знаний — это метод обучения модели машинного обучения обучению на основе другой, более сложной модели. Это позволяет создать меньшую, более эффективную, быструю и, как правило, более производительную модель путем дистилляции знаний из более крупной красивой модели, что и называется дистилляцией знаний. Это быстро развивающийся метод в области глубокого обучения, поскольку он позволяет преобразовать существующие модели, обученные на больших объемах данных, в небольшие автономные модели, которые можно более эффективно развернуть во встроенных системах.

Метод машинного обучения, известный как дистилляция знаний, обычно используется, когда доступен метод, который уже был обучен на больших наборах данных, и для выполнения той же задачи требуется меньшая и более быстрая модель. По сути, дистилляция знаний заключается в извлечении основных концепций большой модели ИИ и обучении меньшей модели выполнять ту же задачу. Этот метод работает, обучая меньшую модель имитировать поведение более крупной модели и тем самым позволяя ей более эффективно обобщать.

Процесс дистилляции знаний включает в себя передачу знаний из более крупной модели в меньшую модель, которая может работать на мобильном или встроенном оборудовании. Это достигается путем введения штрафа в процесс обучения, который побуждает меньшую модель ближе придерживаться поведения более крупной модели.

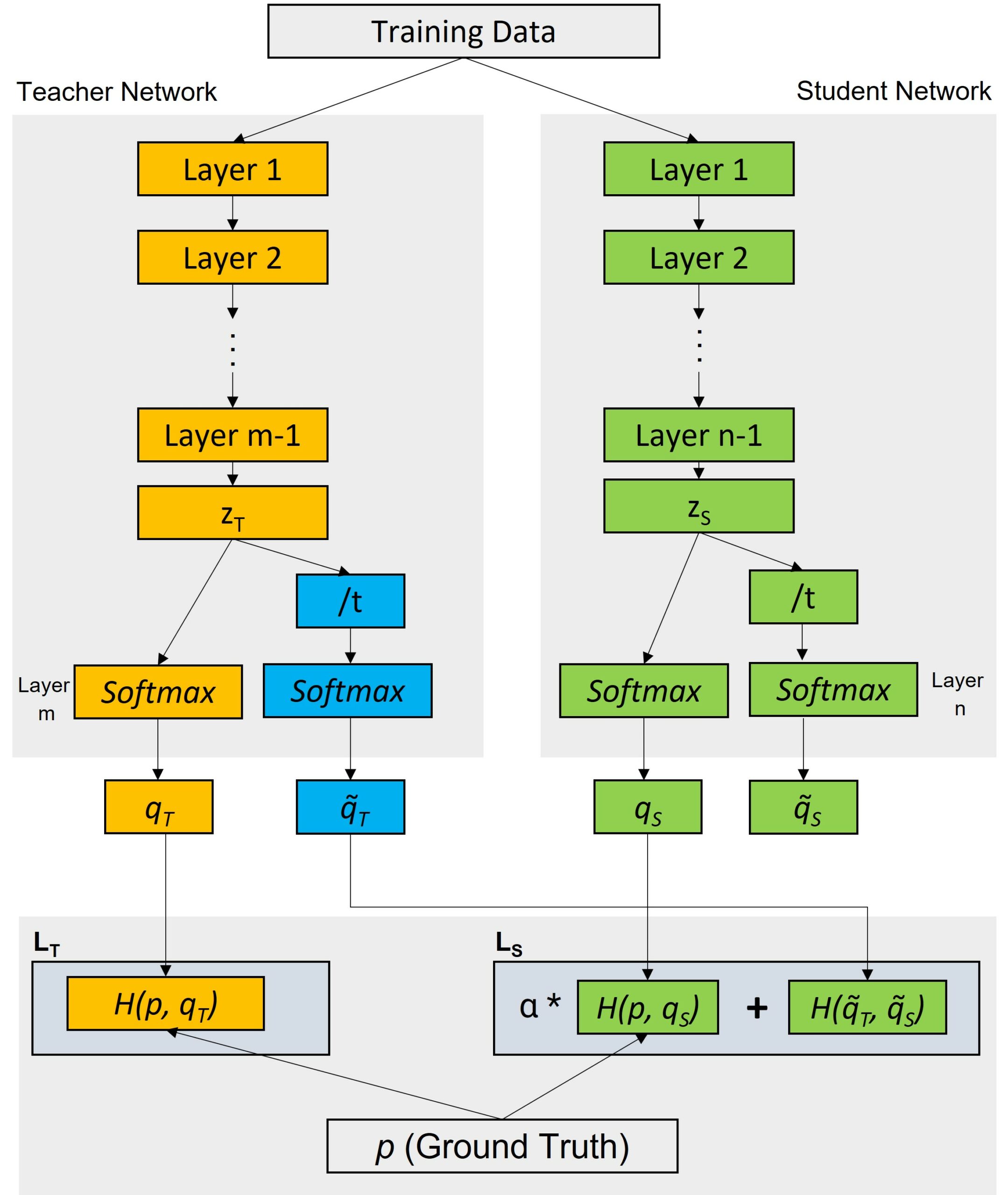

По своей сути дистилляция знаний работает за счет наличия большой модели (учителя), обученной на большом наборе данных, и модели меньшего размера (ученика). Результаты учителя затем используются для определения новой функции потерь, которая используется для обучения ученика. Цель этой новой функции потерь состоит в том, чтобы ученик получал результаты, максимально близкие к результатам учителя, используя при этом наименьшее количество вычислительных ресурсов.

Ценность дистилляции знаний заключается в ее способности создавать модели меньшего размера, которые способны воспроизводить производительность более крупных моделей без ущерба для точности. Это может принести организациям огромную выгоду с точки зрения затрат на вычисления и хранение, позволяя им развертывать более точные модели при ограниченном бюджете. Кроме того, дистилляция позволяет компаниям легко использовать знания, уже полученные при помощи крупных моделей, для расширения и совершенствования своих нынешних моделей экономически эффективным способом.