A Destilação de Conhecimento é um método de ensinar um modelo de aprendizado de máquina a aprender com outro modelo mais complexo. Ele permite a produção de um modelo menor, mais eficiente, mais rápido e geralmente com melhor desempenho, destilando o conhecimento de um modelo maior e bonito, daí denominado destilação do conhecimento. É uma técnica de rápido crescimento no campo da aprendizagem profunda, pois permite que modelos existentes que foram treinados em grandes quantidades de dados sejam destilados em pequenos modelos independentes que podem ser implantados de forma mais eficiente em sistemas embarcados.

A técnica de aprendizado de máquina conhecida como destilação de conhecimento é geralmente usada quando está disponível uma técnica que já foi treinada em grandes conjuntos de dados e um modelo menor e mais rápido é necessário para executar a mesma tarefa. Em essência, a destilação do conhecimento funciona extraindo os conceitos principais de um grande modelo de IA e ensinando um modelo menor a realizar a mesma tarefa. A técnica funciona ensinando o modelo menor a imitar o comportamento do modelo maior e, ao fazer isso, permite generalizar com mais eficiência.

O processo de destilação do conhecimento envolve a transferência do conhecimento de um modelo maior para um modelo menor que pode ser executado em hardware móvel ou embarcado. Isto é feito através da introdução de uma penalidade no processo de treinamento, que incentiva o modelo menor a se aproximar do comportamento do modelo maior.

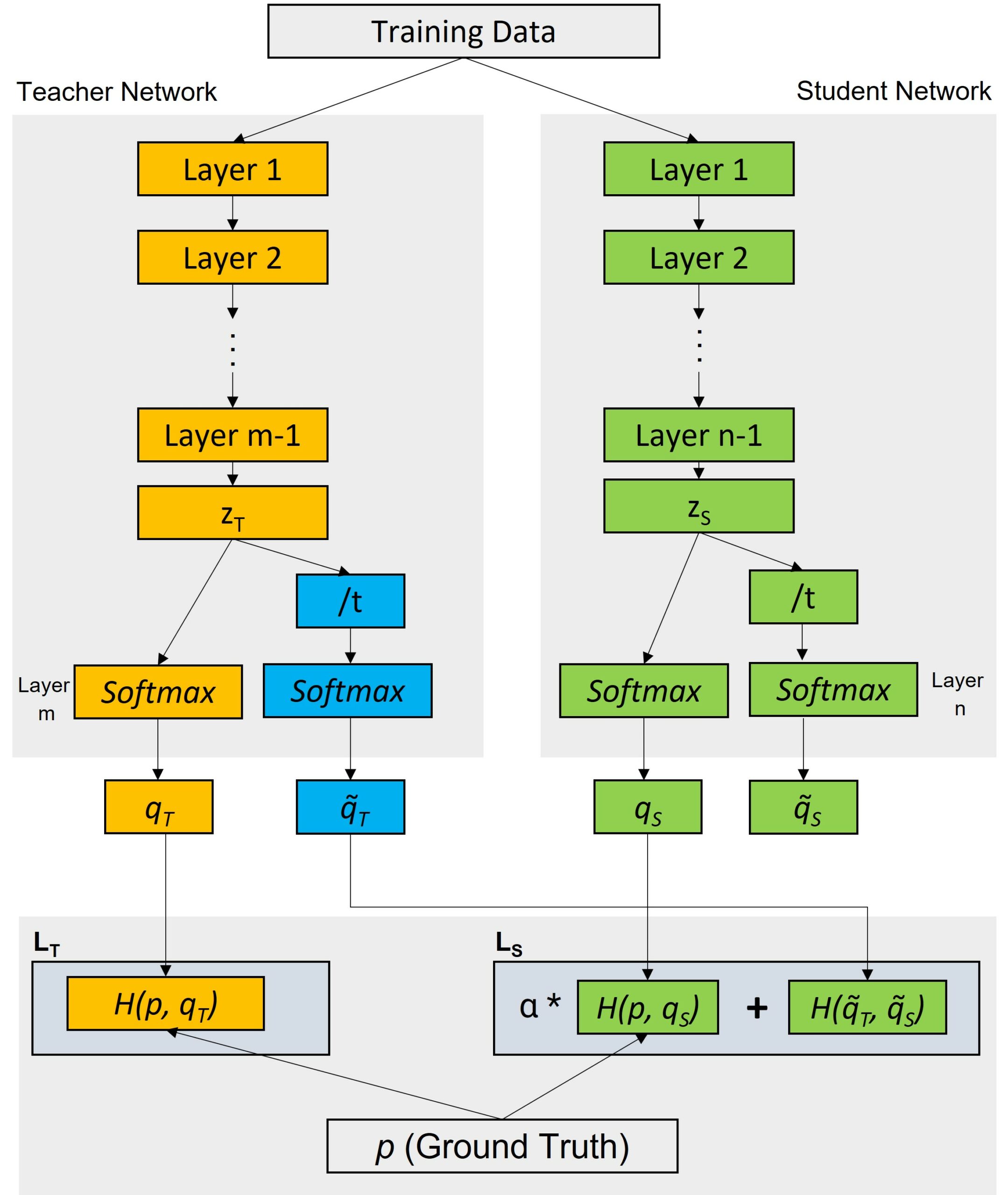

Basicamente, a destilação do conhecimento funciona com um modelo grande (o professor) que foi treinado em um grande conjunto de dados e um modelo menor (o aluno). A saída do professor é então usada para definir uma nova função de perda que é usada para treinar o aluno. O objetivo desta nova função de perda é fazer com que o aluno produza resultados que sejam o mais próximos possível dos resultados do professor, usando a menor quantidade de recursos computacionais.

O valor da destilação do conhecimento reside na sua capacidade de criar modelos menores que sejam capazes de replicar o desempenho de modelos maiores sem sacrificar a precisão. Isto pode resultar em enormes benefícios para as organizações em termos de custos de computação e armazenamento, permitindo-lhes implementar modelos mais precisos dentro do orçamento. Além disso, a destilação permite que as empresas utilizem facilmente o conhecimento já aprendido por grandes modelos para ampliar e refinar os seus modelos actuais de uma forma rentável.