Vapnik-Chervonenkis (VC) 维度是计算学习理论领域的一个重要概念,它提供了模型或系统复杂性的度量。它由 Vladimir Vapnik 和 Alexey Chervonenkis 于 20 世纪 70 年代初开发,用于支持向量机 (SVM) 和相关算法的开发。 VC维度通常用于衡量机器学习算法的能力;也就是说,它从训练集中“学习”并推广到未见过的数据的能力。它对于在使用前了解系统的功能以及评估结果的准确性和可靠性来说都是一个重要的功能。

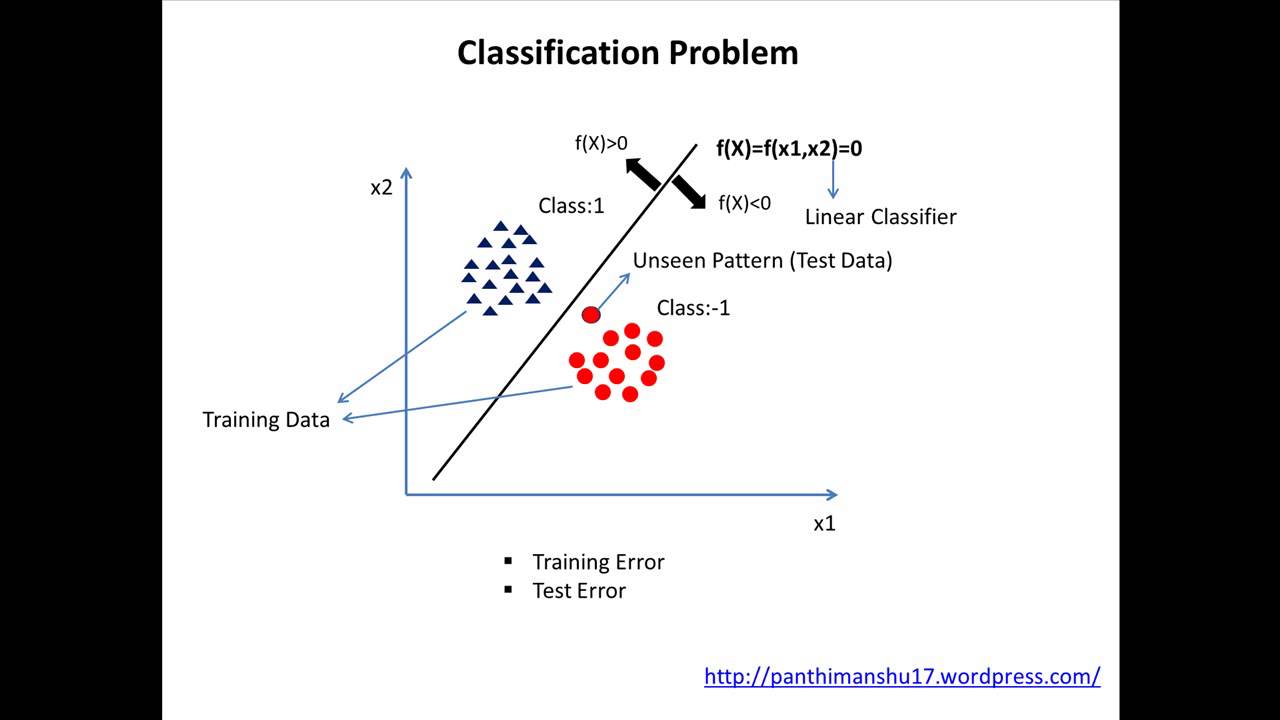

VC 维度定义为模型可以正确分类的不同模式的数量,并由模型中使用的参数数量确定。例如,具有两个自由参数的线性模型可以准确地分类多达三种不同的模式。具有三个自由参数的模型可以准确地对多达七种不同的模式进行分类,依此类推。这种简单的关系可以用VC维数公式来描述,通常表示为:

d_{vc} = m + 1,其中 m 是模型中使用的参数数量。

VC维度最常用于分析监督学习算法的性能,但它也适用于其他类型的模型和系统。特别是,它对于分析神经网络的功能和局限性非常有用,而神经网络由于其复杂性通常很难分析。由于其多功能性和普遍性,VC 维度被认为是计算学习理论中的基本概念,并且是用于评估和比较机器学习算法的准确性和性能的核心工具。

VC 维度有时称为针栈维度或复杂度维度。