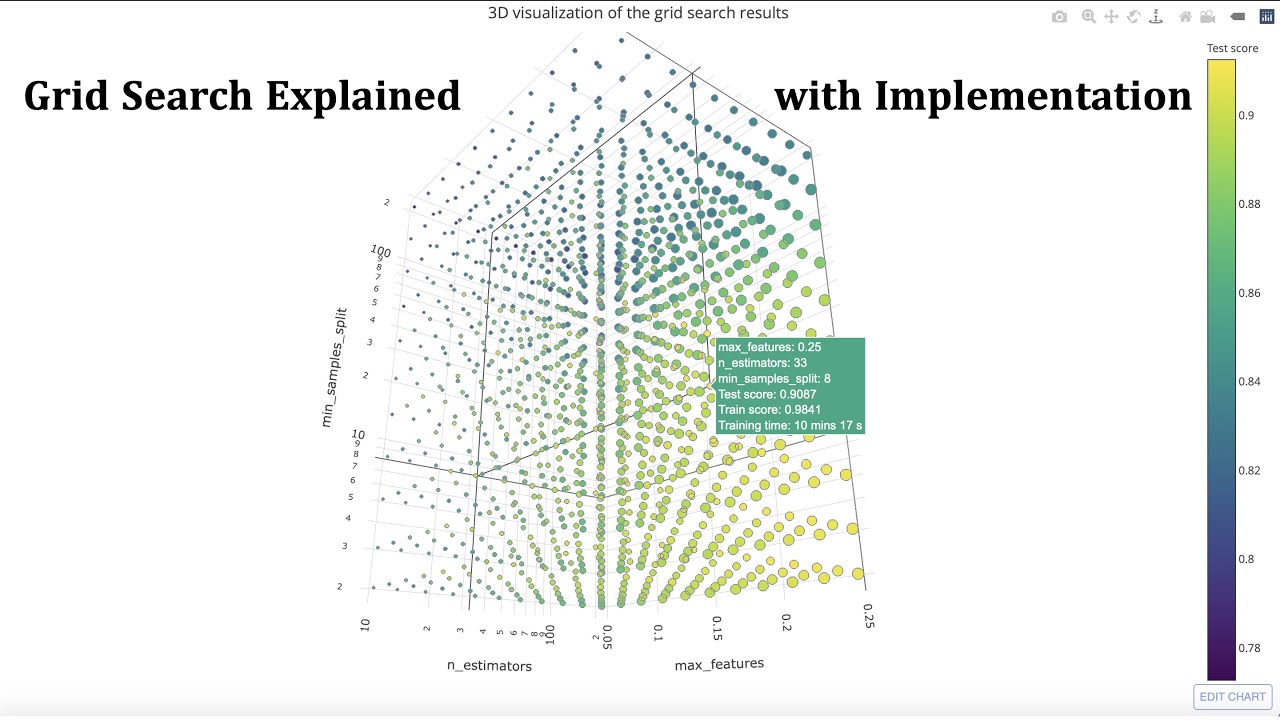

A pesquisa em grade é um algoritmo usado para otimização de hiperparâmetros em aprendizado de máquina. É uma busca bidimensional do espaço de hiperparâmetros, na qual o algoritmo busca a melhor combinação de parâmetros que produza o melhor resultado. É um dos métodos mais comumente usados para ajustar os parâmetros de um modelo porque é relativamente simples de implementar e não requer uma grande quantidade de dados de treinamento ou grandes cálculos.

Na pesquisa em grade, um conjunto finito de valores de parâmetros é selecionado para cada parâmetro. Esses valores de parâmetros são então avaliados em combinações para determinar qual combinação produz o melhor desempenho. As métricas mais comuns usadas para pesquisa em grade são exatidão, precisão, recall e pontuação F1.

A pesquisa em grade é normalmente usada na otimização de hiperparâmetros de algoritmos de aprendizado de máquina supervisionados, incluindo máquinas de vetores de suporte, Naive Bayes, árvores de decisão e vizinhos mais próximos. Também é usado para otimizar hiperparâmetros de redes neurais de aprendizado profundo, como redes neurais convolucionais.

A vantagem da busca em grade é sua eficiência computacional. Não requer uma grande quantidade de dados de treinamento ou poder de computação. No entanto, tem algumas desvantagens. A pesquisa em grade pode se tornar computacionalmente cara se o espaço de pesquisa for grande ou os parâmetros forem contínuos. Também é suscetível a overfitting e pode ser facilmente confundido com ótimos locais e acabar escolhendo uma combinação de parâmetros que não são ótimos.

A pesquisa em grade é uma ferramenta importante e amplamente utilizada para otimização de hiperparâmetros e pode ajudar os profissionais a identificar o melhor modelo para a tarefa.